[pms-logout text="Bienvenido, {{meta_user_name}}" link_text="Salir"]

Investigación aplicada en la Ingeniería | 3635

La inteligencia artificial: fundamentos, tendencias y expectativas

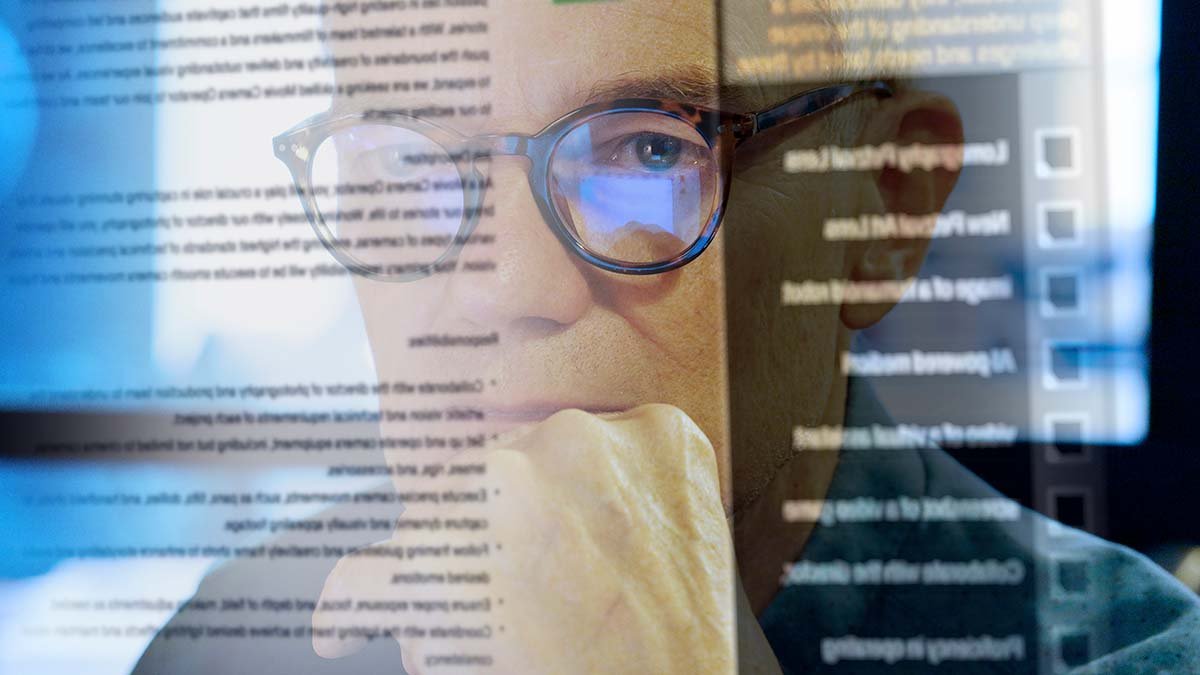

La inteligencia artificial no es una tecnología reciente; como se explicará en este artículo, tiene una historia que abarca varias décadas, al menos, desde mediados del siglo pasado. La IA se nos muestra hoy a través un amplio repertorio de técnicas y herramientas desarrolladas por investigadores y empresas especializadas en este ámbito, alcanzando una mayor notoriedad los métodos de aprendizaje automático (machine learning y deep learning) y los modelos LLM (large language models). El desarrollo de la IA moderna ha permitido que una serie de sistemas basados en el uso de algoritmos inteligentes aplicados sobre masas ingentes de datos digitales (cifras, textos, imágenes, e incluso sonidos) logren un rendimiento que parece sobrehumano. Pero, al mismo tiempo, surgen manifestaciones de una creciente inquietud acerca del comportamiento de esta clase de artefactos inteligentes, sobre si se puede garantizar su transparencia, observabilidad, imparcialidad y funcionamiento responsable. La innovación tecnológica entra aquí en contacto con las esferas de la ética y el derecho, acantonando el camino hacia un futuro de la IA que aún no es posible predecir de manera concluyente.

César Lanza

Ingeniero de caminos, canales y puertos. MSc in Computer Science.

Permita el lector que inicie este artículo introductorio relatando cómo se produjo mi acercamiento, tiempo atrás, desde la ingeniería civil a la inteligencia artificial, hoy tan de moda. Recuerdo que, poco después de terminar mis estudios en la Escuela de Caminos, en junio de 1978, me convencí de la enorme importancia que en lo sucesivo iba a tener lo que entonces llamábamos cálculo electrónico —y, algo más tarde, informática—, no solo en el ámbito profesional de la ingeniería, sino de manera más amplia en el mundo empresarial y posiblemente en el conjunto de la sociedad. Esa razón y mis primeras experiencias laborales en dos empresas punteras de ingeniería, una española y otra norteamericana, me animaron a conocer con más profundidad esas nuevas técnicas del modo que suele ser habitual entre los ingenieros: mediante el estudio sistemático y riguroso, teórico y práctico, en este caso de las denominadas Ciencias de la Computación. Tras competir con éxito por una beca Fulbright trasladé temporalmente mi residencia a California, uno de los epicentros de ese movimiento, en realidad seísmo, tecnológico, con el objetivo de realizar una inmersión académica en una de las universidades más pujantes en la materia. Salí de allí casi dos años más tarde con mi flamante título de Master of Science y un buen bagaje de conocimientos, ideas e ilusiones que pensé podría desarrollar a mi regreso a España.

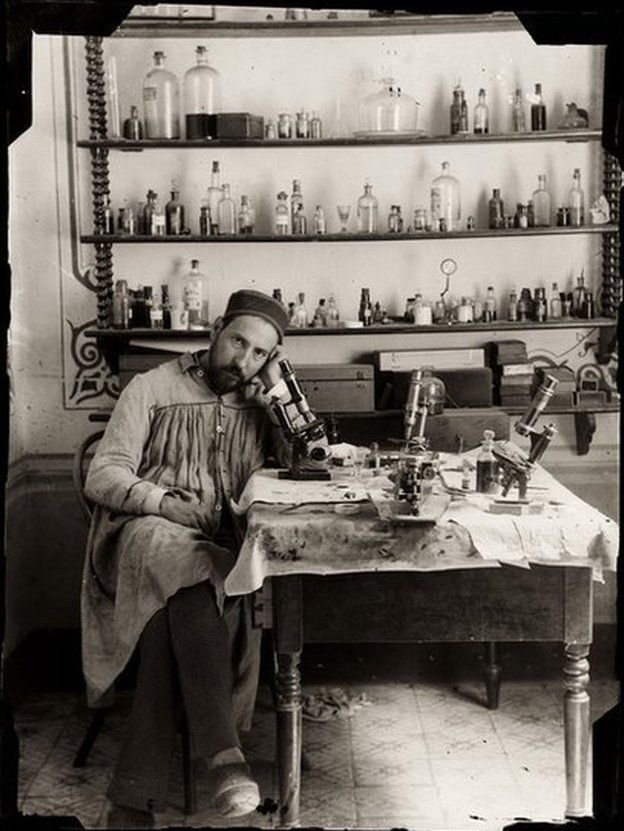

Estábamos entonces a mediados de la década de 1980, y la especialidad que más me había interesado durante mis estudios de postgrado fue precisamente la inteligencia artificial, que entonces se encontraba en la cresta de su segunda ola (la primera había ocurrido en las décadas de 1950 y 1960) y estaba absolutamente en boga, aunque circunscrita a un selecto grupo de universidades, empresas y científicos especializados en este tema. El mundo en que me moví durante ese proceso formativo era del de los lenguajes simbólicos, principalmente LISP y PROLOG; los algoritmos de planificación en contextos complejos (redes de transporte y logística, sistemas energéticos); los sistemas expertos basados en la ingeniería del conocimiento (diagnóstico y terapéutica medica principalmente); los métodos de razonamiento simbólico; la visión artificial y el tratamiento algorítmico del lenguaje natural o lingüística computacional. Aparte de todo aquello —que para mí constituía una novedad absoluta— me llamó mucho la atención el avance en una especialidad concreta que me pareció potencialmente revolucionaria: la del conexionismo y las redes neuronales artificiales preconizadas por Warren McCulloch (1868-1969), neurólogo, y Walter Pitts (1923-1969), lógico matemático. Al menos en California empezaban a despuntar con fuerza, anticipando en cuatro décadas el paradigma que se encuentra en la base de las técnicas actuales más populares dentro del campo de la IA, como el machine learning o los LLM. Recuerdo en ese sentido cómo se veneraba en los departamentos de Ciencia de la Computación de las universidades norteamericanas la figura de Santiago Ramón y Cajal, considerado el precursor de la formalización de la estructura fisiológica del cerebro en términos de redes de neuronas, dendritas, axones y sinapsis. Lo cierto es que el modelo computacional de McCulloch y Pitts ha ido afianzándose desde entonces hasta el punto de convertirse en el paradigma de referencia en la tercera oleada de la inteligencia artificial en la que ahora nos encontramos inmersos.

La inteligencia artificial no es una tecnología reciente; tiene una historia que abarca varias décadas — al menos desde mediados del siglo pasado—, y muestra ciclos de entusiasmo y desilusión que se suceden alternativamente en la valoración de su interés científico, logros técnicos e impacto socioeconómico. Los éxitos recientes han generado un renovado interés por la disciplina y abundan las afirmaciones sobre sus efectos transformadores y disruptivos. Al revisar la historia y el estado actual de la técnica, se nos revela un amplio repertorio de métodos y procesos desarrollados por investigadores y empresas especializadas en este ámbito. En particular, los métodos modernos de aprendizaje automático y los modelos LLM (Large Language Models) han permitido que una serie de sistemas basados en el uso de tales algoritmos inteligentes aplicados sobre masas ingentes de datos digitales (cifras, textos, imágenes e incluso sonidos) logren un rendimiento que parece sobrehumano.

El desarrollo deslumbrante de la informática en cuestiones tales como la potencia computacional de los procesadores, la eficiencia de las arquitecturas distribuidas, la proliferación de programas de software de código abierto, la abundancia de datos disponibles en formato digital y su integración en plataformas multiservicio ha sido crucial para llegar al punto en el que estamos. Al mismo tiempo, hay manifestaciones de una creciente inquietud acerca del comportamiento de esta clase de sistemas inteligentes, hay dudas sobre si se puede garantizar su transparencia, observabilidad, imparcialidad y su funcionamiento responsable. Una consecuencia de los logros recientes en inteligencia artificial es el renacer del interés en torno a la ética de dichos artefactos o, más propiamente, de sus creadores y usuarios. En general, nuestros sistemas de inteligencia artificial siguen basándose en arquitecturas enfocadas hacia tareas concretas, a menudo denominadas inteligencias artificiales de propósito específico o «estrechas». Surge ahora la controversia sobre la posibilidad de que se desarrolle o emerja una inteligencia artificial «general», capaz de abarcar tareas y contextos ampliamente diferentes en un futuro cercano.

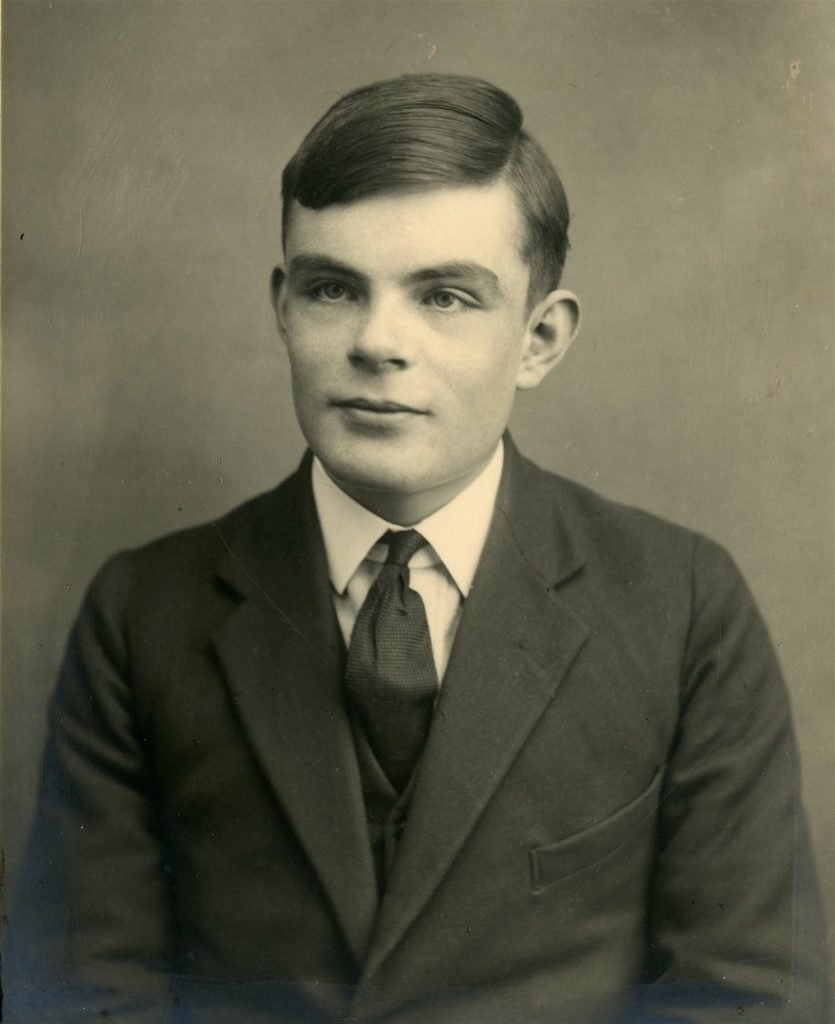

No está de más que antes de referirme al estado del arte de esta tecnología —que ya empieza a impregnar con sus usos y aplicaciones cualquier actividad humana o proceso social— efectúe un recorrido breve por los hechos fundamentales que nos han traído aquí. Los tiempos pioneros de los primeros visionarios —no teóricos especulativos, sino fundadores— vieron surgir figuras de imposible olvido y primerísimo nivel, entre ellos Alan Turing (1912-1954), un célebre matemático inglés considerado el «padre» intelectual de la disciplina; Allen Newell (1927-1992), que codificó por vez primera en términos informáticos determinados procesos cognitivos; Herbert Simon (1916-2001), quien investigó los límites de la racionalidad y la representación algorítmica del razonamiento económico; John McCarthy (1927-2011), creador del lenguaje LISP para la computación recursivo-simbólica; o Marvin Minsky (1927-2016), quien formalizó el primer modelo computacional específico de la IA, el perceptrón, una red neuronal monocapa. Sus trabajos y descubrimientos consolidaron a la primera élite de investigadores y de universidades involucradas en la estructura fundamental de la inteligencia artificial, entre ellas, las bien conocidas de Stanford, MIT, Carnegie-Mellon y la Universidad de California, en especial, los campus de Berkeley y Los Ángeles. En el verano de 1956 tuvo lugar en Dartmouth la primera conferencia sobre inteligencia artificial, organizada por Minsky, McCarthy y Shanon, que reunió a todos los que trabajaban en este nuevo campo de la informática. Como hipótesis de partida se planteó que «cualquier aspecto del aprendizaje u otra característica de la inteligencia humana puede, en principio, ser descrita con precisión de tal forma que se puede construir una máquina que la simule». Y hacia ese objetivo general tan ambicioso parece que se sigue avanzando.

La IA muestra ciclos de entusiasmo y desilusión que se suceden alternativamente en la valoración de su interés científico

En la base de cualquier tecnología de inteligencia artificial, hoy ramificada en un número creciente de especialidades, subyace una cuestión fundamental: la capacidad de la simbiosis de algoritmos, datos y capacidad de procesamiento para representar, de forma operable computacionalmente, determinados aspectos relacionados con la racionalidad y otros atributos valiosos del intelecto humano. Este arduo problema tiene muchas facetas, puesto que la razón y la creatividad son frutos de la mente que no solo dependen de la propia inteligencia sino también de la imaginación, la memoria interna de cada uno, sus conocimientos y experiencias, la información de contexto percibida por los sentidos e, indudablemente, de los sesgos con que cada persona adereza los ingredientes anteriores. También se sabe que razón y creatividad no operan de manera lineal o monotónica, sino que se encuentran sujetas al fenómeno del feedback, o retroalimentación, que fue estudiado y formalizado matemáticamente por Norbert Wiener y su equipo del MIT a mediados del siglo pasado, dando lugar a la ciencia de la cibernética y de los sistemas de control. En España, Leonardo Torres Quevedo hizo un trabajo enormemente meritorio en este campo, pero la irrupción imparable de la electrónica tras la segunda guerra mundial provocó la obsolescencia de sus ingeniosos autómatas electromecánicos, hoy una curiosidad tecno-científica de interés extraordinario.

Por otra parte, la actividad intelectual de los seres humanos no solo es producto de la fría lógica y de un acervo estructurado de datos y conocimientos, pues las denominadas «leyes del pensamiento» obedecen a un complejo entramado de principios, impresiones y creencias en que intervienen, aparte de las matemáticas, la filosofía, la psicología, la economía, la lingüística y las neurociencias, por mencionar algunas de las más notables ramas del conocimiento científico. Además, cuando se trata de mapear aspectos de la mente humana sobre un dispositivo diseñado y construido por el hombre —el ordenador— interviene otro importante cuerpo de saberes técnicos, como son la ingeniería de computadores y la ciencia del software, descompuestas a su vez en innumerables subdivisiones. Toda esta complejidad contrasta enormemente con la sencillez que se encuentra en el fondo de cualquier proceso computacional, basado, en último extremo, en la activación y combinación de puertas lógicas biestables que, según el álgebra booleana, pertenecen a tres clases esenciales —AND, OR y NOT— con algunas variantes. Se puede comprender fácilmente la ingente tarea que supone construir una inteligencia artificial desde un fundamento físico-matemático tan escueto, y el hecho de que, por muchos avances logrados hasta la fecha, la formalización computable del ejercicio de las capacidades racional y creativa sensu stricto sea algo que dista en el tiempo, de hecho, no se sabe siquiera si, en último extremo, será posible. Nos movemos en el campo de las aproximaciones, de los éxitos parciales e incluso de las metáforas, como bien denota el propio nombre dado a esta tecnología: inteligencia artificial. Lo cual, por otra parte, no está mal.

Fue Alan Turing —un espíritu brillante, aunque, como se sabe, con una vida personal muy desgraciada— a quien se asocia con la fundación original de la disciplina. Dando un paso más allá de sus teorías sobre las funciones computables, Turing planteó abiertamente la conocida conjetura sobre si llegaría a ser posible diseñar y construir «máquinas inteligentes». Como él mismo dijo, esa pregunta conducía a un problema nuevo para el conocimiento matemático de su tiempo. Sin embargo, a la luz de lo que se puede deducir de sus trabajos publicados sobre el tema y, en particular, del artículo Computing Machinery and Intelligence, que apareció en la revista Mind en octubre de 1950, Turing reconocía la necesidad de situar el significado de los términos «máquina» y «pensar» en un contexto interpretativo apropiado, advirtiendo explícitamente que acudir a sus acepciones corrientes podía ser peligroso. Propuso en su lugar dilucidar la cuestión mediante el conocido juego de la comparación entre las respuestas de una máquina sometida a escrutinio y las de un ser humano tenido por persona inteligente, al exponer a ambos a un interrogatorio intencional. De esa manera el artefacto inteligente era tratado como una especie de caja negra mediante la interacción pregunta/respuesta, algo que muchos habremos hecho recientemente movidos por la curiosidad cuando se anunció el primero de los sistemas LLM de amplia disponibilidad, conocido comercialmente como Chat GPT.

Esa manera de reconocer la condición de inteligente a una máquina mediante la observación de su funcionamiento no dejaba de ser una renuncia a la comprensión analítica de su estructura interna y su lógica de funcionamiento; por eso Turing hablaba de un problema nuevo para la matemática. Y de ahí viene posiblemente una de las principales precauciones frente al uso de la inteligencia artificial en situaciones o contextos sensibles para la seguridad humana en términos físicos, financieros o políticos, que es el riesgo potencial de impenetrabilidad. Aunque se pretende abordar este dilema por la vía regulatoria —como prevé hacer la Unión Europea— hay un debate abierto sobre si una solución de tal naturaleza será eficaz a efectos prácticos. Bien se sabe que creadores y reguladores suelen actuar como polos opuestos en la dinámica de la innovación tecnológica, y tampoco está de más recordar aquel dicho sobre «poner puertas al campo», aunque suene a rancio y anticuado en relación con algo tan atractivo y novedoso como es la inteligencia artificial.

Creadores y reguladores suelen actuar como polos opuestos en la dinámica de la innovación tecnológica

En la actualidad, la proliferación de técnicas, métodos y herramientas derivados del concepto seminal de inteligencia artificial parece incontable. Sin el ánimo de reducir una panorámica tan variada a unas pocas líneas de progreso dentro del estado del arte de la disciplina, puede considerarse que, por su presencia en los medios y en el mercado informático, así como por su mayor extensión de uso, hoy capturan el interés público las especialidades basadas en el aprendizaje automático, o machine learning, en las diversas variantes de esta tecnología informática de carácter horizontal, y los aún incipientes pero prometedores sistemas basados en el uso de modelos LLM, lo que se ha venido a denominar la inteligencia artificial generativa. Este hecho no ha de hacernos desatender los avances dentro este campo de otra clase de temas en el plano de la investigación aplicada, donde se pueden mencionar, en primer lugar, los métodos de búsqueda —en particular, la búsqueda adversativa en entornos multiagente basados en la teoría de juegos, una rama en la que brilló la luz pionera de Torres Quevedo al inaugurar en 1890 esta especialidad con la invención de un autómata para dar jaque mate en el ajedrez a un rey con rey y torre contrarios. Otras líneas de investigación que han probado su interés y fertilidad en el mundo, hoy tan variado y heterogéneo, de la IA pueden ser los sistemas de representación del conocimiento, el tratamiento de la incertidumbre en los métodos de razonamiento automatizado, o las ramas más recientes de la lingüística computacional para el procesamiento del lenguaje natural. En las áreas de aplicación práctica, las redes inteligentes de sensorización, los sistemas de visión artificial, la robótica de 4.ª o 5.ª generación, o los asistentes personales más o menos evolucionados.

Los sistemas de aprendizaje automatizado, que normalmente suelen encuadrarse dentro de las dos tipologías generales del machine learning y del deep learning, corresponden a formulaciones matemáticas diferentes en cuestiones fundamentales: la representación digital del conocimiento y su algoritmia o tratamiento computacional. Sin entrar aquí en detalles, diremos que se trata de modelos distintos y ámbitos de aplicación que también varían, del mismo modo que lo hacen los requerimientos de la infraestructura informática necesaria para darles soporte, por lo general muy intensiva en capacidad y distribuida entre numerosos procesadores.

Las técnicas del machine learning poseen un potente sustrato científico basado en la estadística matemática, la econometría y la más reciente y sofisticada ciencia de los datos. En su esencia, este tipo de tecnologías inteligentes investigan la aparición de regularidades en conjuntos muy extensos de datos digitalizados para extraer, a partir de ellos, determinadas reglas empíricas o formulaciones heurísticas aplicables a multitud de problemas ad hoc —normalmente de predicción— que las aproximaciones analíticas tradicionales no han conseguido resolver con éxito. La regularidad como fundamento predictivo no deja de seguir el conocido dictum de Leibnitz, que decía aquello de que «la naturaleza no da saltos». Precisamente de ahí proviene la fortaleza del machine learning y también su limitación frente a fenómenos nuevos o altamente improbables. Muchos de esos ejemplos de aplicación provienen de las ciencias sociales, en particular de los campos de la economía, el marketing o la politología, por señalar tres ejemplos bastante corrientes. En sentido laxo puede pensarse que el machine learning presupone que el conocimiento registrado del pasado permite inducir hechos futuros, obligando a reconsiderar en cierta manera las nociones convencionales de causalidad e inferencia; esta es una cuestión peliaguda, tal y como ha puesto de relieve el sustancial trabajo teórico del profesor Judea Pearl, de la UCLA, sobre lo que se ha denominado la nueva ciencia de la causa y el efecto. El deep learning se basa en un paradigma computacional diferente, las redes neuronales multicapa, una forma particular de procesamiento paralelo que también se conoce por conexionismo y que proviene de los trabajos seminales de Minsky y Rosenblath. Su ámbito de aplicación es también amplio, pero en problemas que en principio se encuentran más acotados que los del machine learning, y en los cuales la indeterminación, causal o analítica, no constituye necesariamente la principal dificultad a resolver.

Especular sobre el futuro de la IA es una pérdida real de tiempo en disquisiciones al modo de la antigua Bizancio

Hasta la fecha, el último Wunderkind de la inteligencia artificial son los LLM, Large Language Models, que pueden entenderse a su vez como redes neuronales artificiales especiales, denominadas transformers, que operan sobre datos no etiquetados de tipo texto; es decir, una variante particular del deep learning. Se trata de una rama de la IA de reciente exposición muy espectacular y atractiva por sus resultados e interacción directa con el público a través de herramientas conversacionales tipo chatbot, aunque su ámbito de aplicación es más vasto que el simple curioseo o el juego pregunta-respuesta. Esta clase de redes neuronales utiliza modelos de aprendizaje semisupervisado o no supervisado, y su uso se puede extender a datos de tipo no textual, incluidas las imágenes o los sonidos. El dominio de los LLM es el último campo de batalla de una competencia fiera entre los gigantes de la tecnología, que persiguen la supremacía en un área prometedora.

Finalmente, y de manera muy breve — pues, en mi opinión, especular sobre el futuro de la IA es una manera de debatir sobre lo desconocido y una pérdida real de tiempo en disquisiciones al modo de la antigua Bizancio—, no pueden pasarse por alto las expectativas que genera esta clase de tecnología informática, en particular, sus riesgos potenciales. Bien sea por su presumible «peligrosidad », o porque amenace el empleo o pueda ser la causa de un sinfín de males pronosticados por los profetas de la maldición que afloran de la mano de cualquier novedad disruptiva, contribuyendo a crear un estado de opinión vacilante, o incluso adverso, sobre un indudable vector del progreso tecnológico.

Bajo mi punto de vista, los riesgos para el desarrollo inteligente —valga la redundancia— de la IA en nuestro país son principalmente de dos tipos: en primer lugar, la desinformación, que, maridada con el sensacionalismo de tantos medios, podría afectar negativamente al modo de sentir de la sociedad española sobre este tema tan importante, algo que ya sucedió en la década de 1980 con la energía nuclear. El segundo riesgo sería, por otra parte, el optimismo injustificado y propagandístico que se difunde públicamente de modo irreal sobre el supuesto papel estelar que le correspondería a España en relación con este u otros avances de la modernidad tecnológica —ya sean los microchips o el hidrógeno verde, pasando por el vehículo eléctrico o cualquier otro término de moda y políticamente atractivo. En estas cuestiones serias los resultados no provienen de la ilusión ni de las declaraciones patrióticas; son fruto de una educación tecno-científica excelente, de la iniciativa empresarial, del compromiso inversor a largo plazo, de la bondad regulatoria y del trabajo arduo, todo ello con la necesaria continuidad estratégica y en un régimen de libre competencia. Me viene a la mente aquel desdichado improperio de Unamuno que decía «¡Que inventen ellos!». ¡Ojalá esta vez el sabio bilbaíno se equivoque!